자체 비전 인코더와 거대언어모델 통합한 비전-언어 모델 공개문서·도면·재무제표 등 복합 정보 이해 역량 앞세워 활용성 강화

-

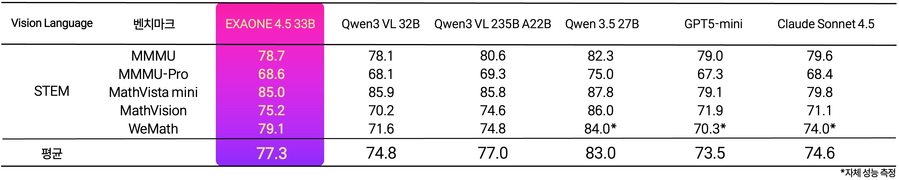

- ▲ 엑사원 4.5 글로벌 동급 모델들과의 STEM 벤치마크 성능 비교ⓒLG AI연구원

LG AI연구원이 텍스트와 이미지를 동시에 이해하고 추론하는 멀티모달 인공지능(AI) 모델 ‘엑사원 4.5’를 공개했다. 기존 언어 중심 AI에서 나아가 시각 정보까지 함께 처리하는 비전-언어 모델로 확장하면서 산업 현장에서 실제 활용할 수 있는 AI 경쟁력 강화에 속도를 내고 있다.LG AI연구원은 9일 공개한 엑사원 4.5가 자체 개발한 비전 인코더와 거대언어모델을 하나의 구조로 통합한 비전-언어 모델이라고 설명했다. 2021년 12월 첫 멀티모달 AI 모델인 엑사원 1.0을 선보인 이후 축적한 기술력을 바탕으로, 텍스트를 넘어 이미지까지 함께 이해하는 방향으로 모델을 고도화했다는 것이다.이번 모델은 LG가 추진 중인 독자 AI 파운데이션 모델 프로젝트 ‘K-엑사원’의 모달리티 확장을 위한 기술적 기반 성격도 갖는다. LG AI연구원은 향후 음성과 영상은 물론, 가상 환경을 넘어 물리적 세계를 이해하고 판단하는 피지컬 인텔리전스로까지 확장하는 것을 목표로 제시했다.엑사원 4.5의 핵심 강점은 산업 현장에서 다뤄지는 복합 문서 이해 능력이다. 계약서, 기술 도면, 재무제표, 스캔 문서처럼 텍스트와 이미지가 섞여 있는 자료를 읽고 맥락을 파악한 뒤 추론할 수 있도록 설계됐다. 단순히 글자나 도형을 인식하는 수준을 넘어, 문서 안의 관계와 의미를 해석하는 데 초점을 맞췄다.LG AI연구원은 성능 평가 결과도 함께 공개했다. 엑사원 4.5는 STEM 성능을 측정하는 5개 지표 평균에서 77.3점을 기록해 GPT-5 mini, Claude Sonnet(앤트로픽 클로드 소넷) 4.5, 중국 알리바바 큐웬(Qwen)3 235B를 웃돌았다. 또 일반 시각 이해 3개 지표와 문서 이해·추론 5개 지표를 포함한 총 13개 시각 평가 지표 평균 점수에서도 GPT-5 mini, Claude Sonnet 4.5, Qwen3-VL보다 높은 점수를 기록했다.코딩 성능 대표 지표인 라이브코드벤치 v6에서는 81.4점을 기록해 구글 젬마 4를 앞섰고, 복잡한 차트 분석과 추론 능력을 평가하는 ChartQA Pro에서는 62.2점을 기록했다고 회사는 설명했다.엑사원 4.5는 330억개 파라미터 규모로, 지난해 말 공개된 K-엑사원보다 크기를 크게 줄였다. LG AI연구원은 모델 규모가 K-엑사원의 약 7분의 1 수준이지만, 텍스트 이해와 추론 영역에서는 동등한 수준의 성능을 구현했다고 설명했다. 하이브리드 어텐션 구조와 멀티 토큰 예측 기반의 고속 추론 기술을 적용한 결과라는 의미다.지원 언어도 확대했다. 기존 한국어와 영어에 더해 스페인어, 독일어, 일본어, 베트남어까지 공식 지원 언어에 포함시켰다. 멀티모달 성능 강화와 함께 글로벌 활용 가능성도 넓히려는 포석으로 풀이된다.LG AI연구원은 이날 엑사원 4.5를 글로벌 오픈소스 플랫폼 허깅페이스에 연구·학술·교육 목적으로 공개했다. 2024년 8월 엑사원 3.0을 오픈 웨이트로 선보인 데 이어 외부 연구자와 개발자들이 활용할 수 있는 생태계를 확장하겠다는 의도로 읽힌다.LG는 엑사원을 청년 AI 인재 육성에도 활용하고 있다. 이달 초에는 경량화 모델 개발을 주제로 한 ‘LG 에이머스’ 해커톤을 진행하며 엑사원을 교육 자원으로 활용했다. 연구개발뿐 아니라 인재 양성과 생태계 확장까지 엮는 전략이다.LG AI연구원은 엑사원을 한국어와 한국 문화, 역사, 사회적 맥락까지 깊이 이해하는 AI로 고도화하겠다는 계획도 내놨다. 올해 1월부터 동북아역사재단의 데이터를 제공받아 학습을 진행 중이며, 고품질 데이터를 보유한 국내 기관들과의 협업도 논의하고 있다고 밝혔다.