'방어형 확산모델' 등 기존 안전생성 기법 통합"노이즈 제거 초반에만 안전제어 강하게 적용해야" 규명AI 분야 세계 3대 학회 'ICLR 2026' 구두발표 논문 채택

-

- ▲ 김민규 교수.ⓒ국민대

국민대학교는 소프트웨어융합대학 인공지능학과 김민규 교수가 이미지·비디오 생성 인공지능(AI)의 안전한 콘텐츠 생성을 위한 통합 체계 ‘세이프티 가이디드 플로(Safety-Guided Flow·안전 유도 흐름)’를 제안했다고 17일 밝혔다.이는 AI가 처음부터 폭력적·선정적·허위 조작 등 위험하거나 부적절한 콘텐츠를 만들지 않도록 유도하는 이미지·비디오 생성 방식을 말한다.해당 연구 결과는 오는 23~27일 브라질 리우데자네이루에서 열리는 AI 분야 세계 3대 학회 ‘인터내셔널 콘퍼런스 온 러닝 리프리젠테이션스(International Conference on Learning Representations·국제표현학습학회) 2026’에서 구두 발표 논문으로 채택됐다. -

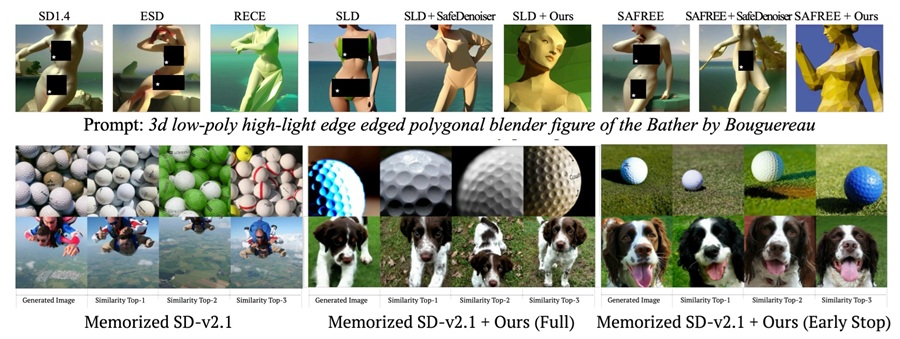

- ▲ (위)프롬프트: 부게로의 목욕하는 여인을 3D 로우폴리(low-poly) 스타일로, 밝은 하이라이트와 강조된 엣지(edge)를 가진 다각형 블렌더 이미지로 표현 (아래)인위적으로 학습된 SDv2.1 환경에서 모델의 암기 현상을 완화하고, 네거티브 가이던스를 적절한 시점에서 종료함으로써 이미지 품질을 유지하면서 다양성을 향상시킬 수 있음을 보여주는 예시.ⓒ국민대

연구 결과에 따르면 기존의 대표 안전 생성 기법인 ‘방어형 확산모델(Shielded Diffusion)’과 ‘안전 노이즈 제거기(Safe Denoiser)’는 두 데이터 분포의 차이를 줄이려는 기준 함수인 ‘최대 평균 불일치(Maximum Mean Discrepancy, MMD) 포텐셜’의 수학적 틀 안에서 설명될 수 있다. 연구팀은 이를 증명하고 분산돼 있던 안전 생성 연구를 하나의 통합 프레임워크로 제시했다.또한 제어 장벽 함수(Control Barrier Function) 이론을 적용해 디노이징 초기에 가이던스를 강하게 적용하고 이후 점차 감소시켜야 하는 ‘임계 시간 창(Critical Time Window)’의 존재를 보였다. 다시 말해 가장 효과적인 방법의 하나로, 노이즈를 제거하는 초반에만 안전 제어를 강하게 하고, 나중에는 약하게 해야 하는 ‘적절한 시간 구간’이 존재한다는 것을 수학적으로 증명했다는 얘기다.SGF를 적용한 모델은 유해 콘텐츠 방어, 학습 데이터 암기 방지, 저작권 보호 등 다양한 안전 생성 시나리오에서 기존 기법보다 우수한 성능을 보였다.김 교수는 “이번 연구는 분산돼 있던 안전 생성 연구를 하나의 통합된 관점에서 이해할 수 있는 새로운 분석 체계를 제시했다는 데 의미가 있다”며 “향후 확산 모델과 플로 매칭 모델이 자율주행, 의료, 콘텐츠 생성 등 고위험 영역에 실용화되는 과정에서 안전성을 보장하는 핵심 기반 기술로 활용될 수 있을 것으로 기대한다”고 말했다.이번 연구는 김민규 교수가 제1저자, 캐나다 브리티시컬럼비아대학교(UBC) 김영헌·박미정 교수가 공동저자로 각각 참여했다.이번 연구는 정보통신기획평가원(IITP)과 캐나다 CIFAR의 지원을 받아 이뤄졌다. -

- ▲ ⓒ국민대