알고리즘이 이미지 각도·밝기·노이즈 등 변형하며 다각도로 조작 가능성 검증기존 모델 재학습 없이 적용 가능 … 추가 비용 없이 추론속도·메모리 효율성 확보서울시립대 엄대호 교수팀 공동 연구 … 신뢰도 중요한 자율주행·보안·의료 등에 활용 기대오는 6월 AI 분야 세계 최고 권위 'CVPR 2026'서 논문 발표

-

- ▲ 김선오 단국대 교수(왼쪽)와 엄대호 서울시립대 교수.ⓒ단국대

단국대학교는 AI융합대학 컴퓨터공학과 김선오 교수팀이 인공지능(AI)의 신뢰도를 떨어뜨리는 ‘적대적 공격(Adversarial Attack)’을 효과적으로 방어하는 기술을 개발했다고 21일 밝혔다.이번 연구는 서울시립대 전자전기컴퓨터공학부 엄대호 교수와 공동으로 진행했다.적대적 공격은 이미지나 데이터 등을 사람은 인지하기 어려울 정도로 미세하게 조작해, AI가 전혀 다른 대상으로 인식하게끔 속이는 방법이다. 이는 AI가 산출한 결과를 왜곡시켜 자율주행, 보안, 의료영상 등 높은 정확성과 신뢰성이 요구되는 분야에서 심각한 위험 요소로 지적돼 왔다.기존 AI 모델은 하나의 입력된 이미지에 의존해 판단을 내리는 방식으로, 작은 교란에도 쉽게 잘못된 결과를 산출할 수 있는 한계가 있었다. 가령, 사람은 고양이 이미지를 전체적인 형태와 의미로 판단하지만, AI는 이미지를 수많은 픽셀 숫자의 조합으로 인식하기 때문에 입력 벡터가 살짝 변형되면 계산 결과가 흔들린다. 이런 교란 행위를 사람은 못 느끼지만, AI는 숫자 패턴이 달라지기 때문에 쉽게 속는 것이다. -

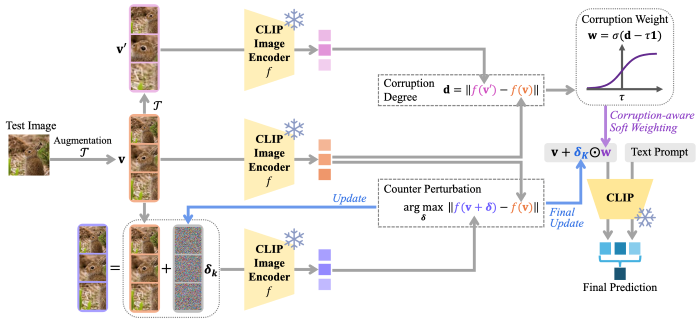

- ▲ 대규모 비전-언어모델(CLIP)의 적대적 공격 회피 방법에 관한 설명도.ⓒ서울시립대

연구팀은 이런 한계를 극복하기 위해 ‘MAC(Multi-View Guided Adaptive Counterattack·다중 시점 기반 적응형 대응 공격)’ 기법을 제안했다. 이는 하나의 입력된 이미지로 결과를 판단하는 기존 AI 모델과 달리 여러 이미지를 동시에 분석해 변형이나 오염 정도를 추정하고, 이에 맞춰 결과를 보정하는 방식이다.다시 말하면, 이미지가 입력됐을 때 설계된 알고리즘이 해당 이미지의 각도·밝기 변화, 노이즈 추가 등의 변형을 자동으로 수행하고, AI는 여러 버전의 결과를 종합해 적대적 공격이 있더라도 쉽게 휘둘리지 않고 안정적으로 판단할 수 있게 하는 것이다. 여기서 한 가지 문제는 입력된 이미지가 이미 오염됐을 수 있다는 점인데, 조작된 이미지라도 어떤 변형에서는 공격 효과가 약해지거나 영향이 달라질 수 있기 때문에 AI로선 여러 변형된 결과 간 일관성을 따져 판단의 안정성을 높이게 된다.이번 기술은 기존 모델을 재학습하지 않고도 추론 단계에서부터 적용이 가능한 것이 특징이다. 추가적인 학습 비용 없이도 추론 속도와 메모리 효율성을 확보해 안정적인 성능을 유지할 수 있다. 연구팀은 총 20개의 데이터셋 실험에서 세계 최고 수준의 성능을 검증했다.김선오 교수는 “AI가 입력된 데이터를 다양한 시각에서 재검증하고, 공격 정도에 따라 스스로 보정하도록 설계한 게 이번 연구의 핵심”이라며 “AI의 안전성과 신뢰성이 중요한 자율주행, 보안, 의료영상 분석 등 다양한 분야에서 활용될 수 있다”고 말했다.이번 연구는 세계 최고 권위의 인공지능·컴퓨터비전 학술대회인 'CVPR(Computer Vision and Pattern Recognition, 컴퓨터 비전과 패턴 인식) 2026’에 채택됐다. 오는 6월 3~7일 미국 덴버에서 열리는 행사장에서 발표될 예정이다. CVPR은 국제전기전자학회(IEEE)와 컴퓨터비전재단(CVF)이 주최하는 학회로, 전 세계 주요 대학과 연구기관, 글로벌 기업이 최신 연구성과를 발표하는 학술 무대다. -

- ▲ 단국대학교 죽전캠퍼스 전경. 우측 하단은 안순철 총장.ⓒ단국대